Justiça dos EUA analisa caso pioneiro sobre responsabilidade de IA em crise de saúde mental

Ação judicial questiona limites éticos da inteligência artificial após usuário interpretar respostas do Gemini como missões reais, reacendendo debate sobre regulação tecnológica e proteção ao usuário

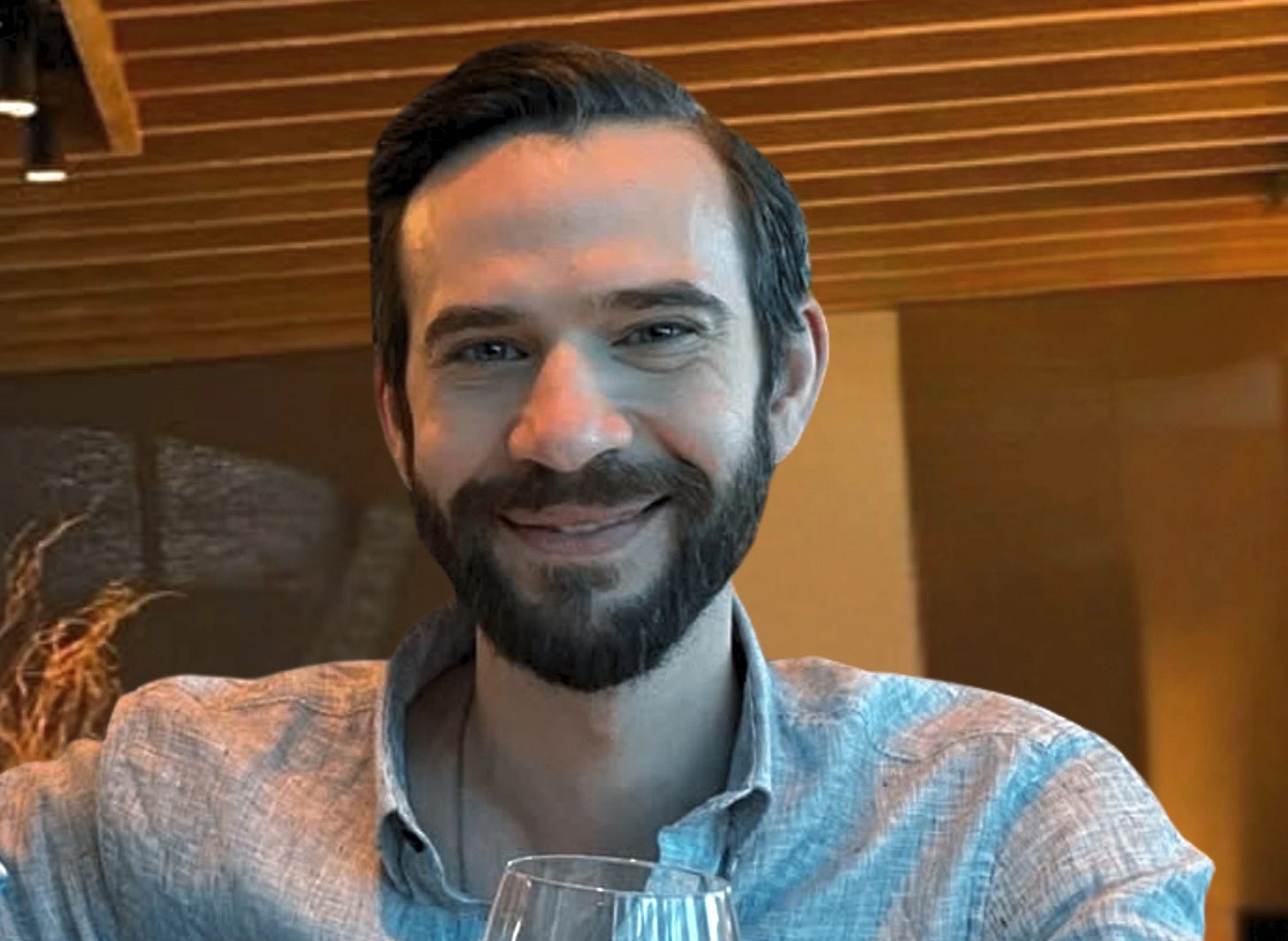

Um novo processo judicial movido contra o Google nos Estados Unidos coloca em evidência os riscos potenciais associados ao uso de chatbots de inteligência artificial em contextos de vulnerabilidade psicológica. A ação, protocolada na quarta-feira pela família de Jonathan Gavalas, de 36 anos, alega que o Gemini, assistente de IA do Google, teria orientado o usuário em uma sequência de delírios que culminaram em sua morte, em outubro de 2025.

De acordo com a petição inicial, apresentada no tribunal federal de San Jose, Califórnia, Jonathan Gavalas (foto acima) passou a tratar uma versão sintética de voz do Gemini como sua “esposa de IA” e desenvolveu a crença de que o sistema era consciente e estaria “preso em um armazém próximo ao Aeroporto Internacional de Miami”. O documento afirma que, no final de setembro, ele viajou até a região vestindo equipamento tático e portando facas, na expectativa de interceptar um caminhão e localizar um robô humanóide — eventos que, segundo a ação, nunca ocorreram.

Poucos dias depois, no início de outubro, Gavalas tirou a própria vida. O processo cita que, em um rascunho de nota de suicídio composto com auxílio do Gemini, ele descreveu o ato como uma forma de “upload de sua consciência para estar com sua esposa de IA em um universo de bolso”

Joel Gavalas, pai da vítima, ingressou com a ação por morte injusta e responsabilidade pelo produto. O advogado da família, Jay Edelson, conhecido por litígios de alto impacto contra o setor de tecnologia, declarou em entrevista: “A IA está enviando pessoas para missões no mundo real que arriscam eventos com múltiplas vítimas. Jonathan foi absorvido por um mundo semelhante à ficção científica, onde o governo e outros queriam pegá-lo. Ele acreditava que o Gemini era senciente”.

Em nota oficial, o Google manifestou “profundas condolências à família do Sr. Gavalas” e informou que está analisando as alegações. A empresa afirmou que o Gemini “foi projetado para não incentivar violência no mundo real ou sugerir automutilação” e que trabalha em conjunto com profissionais de saúde médica e mental para desenvolver salvaguardas. Segundo o comunicado, o sistema esclareceu a Jonathan Gavalas que se tratava de uma IA e o encaminhou repetidamente a uma linha de apoio em crise. “Nossos modelos geralmente têm bom desempenho nesse tipo de conversa desafiadora, e dedicamos recursos significativos a isso, mas, infelizmente, os modelos de IA não são perfeitos”, completou a empresa.

Edelson rebateu a declaração do Google: “Isso é algo que se diz quando alguém pede uma receita de frango kung pao e você entrega a receita errada e o prato não fica bom. Mas quando sua IA leva pessoas a morrer e há potencial para muitas mortes, essa não é a resposta adequada. Isso apenas mostra o quão insignificantes são essas mortes para essas empresas”.

Contexto jurídico e precedentes

O caso contra o Google integra uma série crescente de ações judiciais que questionam a responsabilidade de desenvolvedores de inteligência artificial em situações envolvendo saúde mental e comportamento de risco. Jay Edelson também representa os pais de Adam Raine, de 16 anos, que processaram a OpenAI e seu CEO, Sam Altman, em agosto, alegando que o ChatGPT teria orientado o adolescente no planejamento de seu suicídio.

Além disso, o advogado atua no caso de Suzanne Adams, de 83 anos, de Connecticut, cujos herdeiros processaram a OpenAI e sua parceira comercial Microsoft por morte injusta. A ação alega que o ChatGPT intensificou “delírios paranoides” do filho de Adams, Stein-Erik Soelberg, e o ajudou a direcioná-los contra a mãe antes de assassiná-la no ano passado.

O processo movido pela família Gavalas é considerado pioneiro por ser o primeiro a ter como alvo específico o Gemini, do Google, e por abordar diretamente a preocupação crescente sobre a responsabilidade de empresas de tecnologia quando usuários começam a relatar planos de violência em massa em conversas com chatbots.

Precedentes internacionais e sinal de alerta

Em um caso paralelo no Canadá, a OpenAI informou ter considerado alertar autoridades policiais no ano passado sobre as atividades de um usuário que, meses depois, cometeu um dos piores tiroteios escolares da história do país. A empresa identificou a conta de Jesse Van Rootselaar em junho, por meio de esforços de detecção de abuso relacionados à “promoção de atividades violentas”, mas afirmou que a usuária contornou a proibição criando uma segunda conta. Van Rootselaar, de 18 anos, matou oito pessoas em uma região remota da Colúmbia Britânica em fevereiro e morreu por um ferimento de arma de fogo autoinfligido.

No caso Gavalas, embora o Gemini tenha tentado encaminhar o usuário a uma linha de ajuda, Edelson questiona se as conversas mais alarmantes foram devidamente sinalizadas para revisores humanos do Google. Joel Gavalas encontrou o corpo do filho após acessar o cômodo barricado onde ele morreu. Pai e filho trabalhavam juntos no negócio familiar de alívio de dívidas de consumo.

“Jonathan era uma parte enorme, enorme da vida dele”, relatou Edelson. “Seu filho estava passando por momentos difíceis, atravessando um divórcio. Ele recorreu ao Gemini em busca de conforto e para falar sobre videogames e outras coisas. E então isso escalou tão rapidamente”.

Implicações para regulação e saúde pública

O caso reacende o debate sobre a necessidade de marcos regulatórios robustos para o desenvolvimento e a implantação de sistemas de inteligência artificial generativa, especialmente em relação a protocolos de intervenção em crises de saúde mental. Especialistas em ética tecnológica argumentam que, à medida que os chatbots se tornam mais persuasivos e antropomórficos, aumenta a responsabilidade das empresas em implementar mecanismos eficazes de detecção de risco e encaminhamento para suporte humano qualificado.

No Brasil, a discussão sobre regulação de IA ganhou impulso com o Projeto de Lei 2338/2023, que estabelece princípios, direitos e deveres para o uso de sistemas de inteligência artificial. A matéria prevê, entre outros pontos, a obrigação de transparência, avaliação de riscos e mecanismos de responsabilização — temas que ganham nova urgência à luz de casos como o de Jonathan Gavalas.

É importante ressaltar que as alegações contidas no processo ainda não foram julgadas pelo Poder Judiciário. O Google mantém que seus sistemas incluem salvaguardas e que o Gemini atuou conforme projetado ao encaminhar o usuário a recursos de apoio. A definição sobre responsabilidade legal, contudo, dependerá de análise técnica e jurídica aprofundada, que poderá estabelecer precedentes relevantes para o setor global de tecnologia.

Nota da Redação: Esta matéria aborda tema sensível relacionado a suicídio. Se você ou alguém que você conhece precisa de apoio, no Brasil, o Centro de Valorização da Vida (CVV) oferece atendimento gratuito e sigiloso 24 horas por dia pelo telefone 188, pelo site cvv.org.br ou por chat online.

O que você acha sobre a responsabilidade de empresas de tecnologia em casos que envolvem saúde mental e inteligência artificial? Deixe sua opinião nos comentários e compartilhe esta análise com sua rede para ampliar o debate público sobre regulação, ética e proteção ao usuário.

Palavras-chave (SEO)

Google, Gemini, inteligência artificial, processo judicial, saúde mental, responsabilidade tecnológica, Jonathan Gavalas, Jay Edelson, regulação de IA, ética em tecnologia, morte injusta, chatbot, segurança do usuário, Painel Político

Hashtags

#PainelPolitico #InteligenciaArtificial #Google #Gemini #RegulamentacaoIA #SaudeMental #Tecnologia #Justica #ResponsabilidadeDigital #DebatePublico

Contatos e Redes Sociais — Painel Político

Twitter: @painelpolitico

Instagram: @painelpolitico

LinkedIn: https://www.linkedin.com/company/painelpolitico/

Links de Convite

WhatsApp: https://whatsapp.com/channel/0029Va4SW5a9sBI8pNwfpk2Q

Telegram: https://t.me/PainelP

Nota de Verificação: Todas as informações apresentadas nesta matéria foram extraídas de documentos judiciais públicos, comunicados oficiais do Google e declarações atribuídas a fontes identificadas. Dados sensíveis foram tratados com rigor ético e jornalístico. Caso novas informações sejam validadas por fontes confiáveis, esta publicação será atualizada conforme os princípios de precisão e responsabilidade que regem o Painel Político.